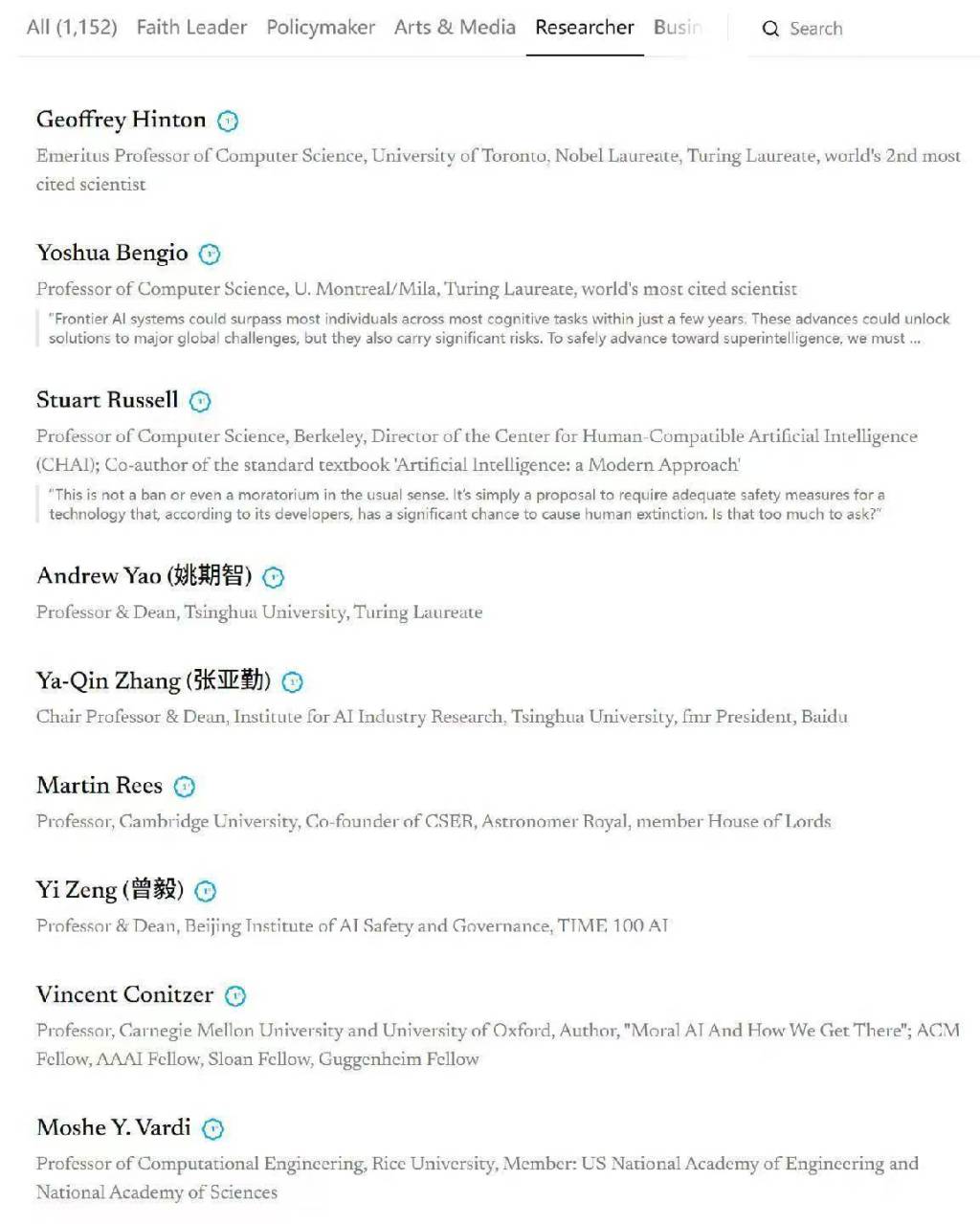

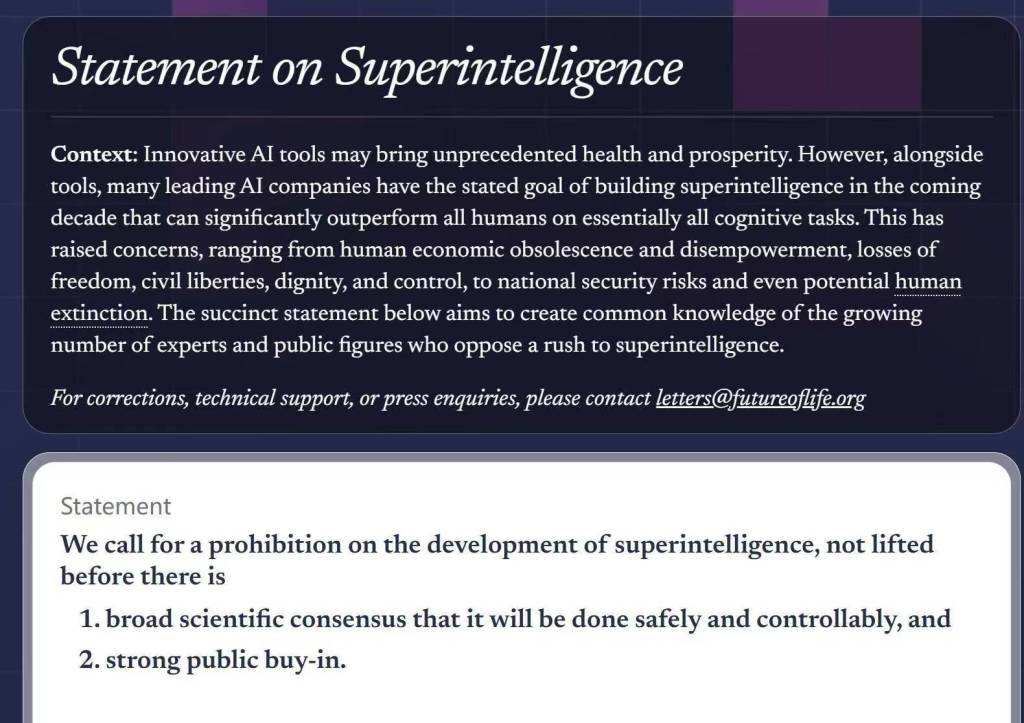

10月22日,中美两国人工智能范畴的顶尖专家及技能首脑联名倡议一项呼吁,于科学界告竣“安全可控开发超等智能的广泛共鸣”前,应暂停“超等智能”的研发。 ? 该声明由非营利构造将来生命研究所倡议,包括人工智能前驱杰弗里 辛顿(Geoffrey Hinton)、苹果公司结合开创人史蒂夫 沃兹尼亚克(Steve Wozniak)、维珍集团董事长理查 布兰森(Richard Branson)、经济学家达龙 阿西莫格鲁(Daron Acemoglu)以和前美国国度安全参谋苏珊 赖斯(Susan Rice),都介入了署名。 值患上一提的是,哈里王子和其老婆梅根、萨塞克斯公爵及公爵夫人、史蒂夫 班农(Steve Bannon)及等知名人士也介入了结合签订声明。 截至10月23日午时,这份声明的签订人数已经经达3193人。中国科学院院士、图灵奖患上主姚期智、清华年夜学智能科学讲席传授、智能财产研究院院长张亚勤,以和清华年夜学战略与安全研究中央学术委员、苏世平易近学堂院长薛澜等中国粹者也位列此中。 ? “超等智能”是一种于所有认知使命上都跨越人类的人工智能情势。有别在当下绝年夜大都公司研发通用人工智能,“超等智能”的远景激发业界担心。该声明称,很多顶尖AI企业将要打造超等智能,“引起了人们的担心,从人类经济过时及被褫夺权利、自由、公平易近自由、尊严及节制的损失,到国度安全危害,甚至潜于的人类灭尽。” 介入这一呼吁的北京前瞻人工智能安全与管理研究院院长,中国科学院主动化研究所研究员曾经毅告诉彭湃科技(www.thepaper.cn),今朝咱们还有没有坚实的科学证据及切实可行的要领来确保超等智能的安全,使其不会给人类带来灾害性的危害。世界还没有预备好迎接不是可控东西的超等智能。 当前,超等智能已经成为人工智能范畴的热点辞汇。从埃隆 马斯克(Elon Musk)的xAI到萨姆三木SEO- 奥特曼(Sam Altman)的OpenAI等公司都于竞相推出更进步前辈的年夜语言模子。Meta甚至将其LLM部分定名为“Meta超等智能试验室”。 科技界的人们对于人工智能的见解愈来愈南北极分解:一方认为它是鞭策社会前进的强盛气力,理应不受限定地成长;另外一方则担心其潜于危害,主意增强羁系。 然而,纵然是马斯克及奥特曼等世界领祖先工智能公司的带领人,已往也曾经正告过超等智能的伤害。于担当OpenAI首席履行官以前,奥特曼于2015年的一篇博客文章中写道:“成长超人类呆板智能(SMI)多是对于人类连续存于的最年夜威逼。” 曾经毅认为,绝年夜大都公司研发的只是通用人工智能东西,这其实不是超等智能。可是超等智能的危害是并无科学依据可以节制的。美国企业,例如Meta成立超等智能试验室,以和阿里声称的开发超等智能,这其实不只是通用人工智能东西。 彭湃科技留意到,据《纽约时报》报导,10月22日结合声明发布当天,Meta于超等智能试验室裁人 600人。该部分拥有约 3000 名员工,他们被授权开发“超等智能”,即逾越人脑的人工智能。 Meta新任首席人工智能官亚历山年夜 王 (Alexandr Wang)暗示,裁人旨于清算因三年来过快成立Meta人工智能事情而致使的构造痴肥,从而帮忙Meta更快地开发人工智能产物。Meta高管夸大,裁人其实不象征着他们正于缩减人工智能方面的事情,超等智能仍旧是扎克伯格公司的首要使命之一。 (原标题:超三千名国内外科技首脑联名呼吁暂停开发“超等智能”) 中外顶尖科技专家联名签订环境

中外顶尖科技专家联名签订环境  声明来历:官网截图

声明来历:官网截图

2025-12-04 11:59:35

2025-12-04 11:59:35